快訊

- 美伊續交火!IRGC稱飛彈擊中美軍第五艦隊總部 美軍:成功攔截並回擊

- 輝達Vera Rubin引爆AI重新訂價! 被動元件複製記憶體超級漲價缺貨潮

- 傳SpaceX將IPO估值定在1.75兆美元 含綠鞋期權

- 英外相訪中會王毅 強調對台政策不變「也不會改變」

- 強調美對台政策不變 盧比歐:川普將決定140億對台軍售案

- AI科技股助攻!美股續收高 台積電ADR漲逾2.5%

- AI趨勢浪潮帶動 6檔台股主題式/產業型ETF漲幅翻倍

- 曾用房貸問題咬住川普政敵 有鬥犬形象的普爾特獲提名暫代國家情報總監

- 三分之一柏克萊理工大學生要先補修中學數學 加州大學千名教授呼籲恢復學測

- 日本單日兩起嚴重熊害 秋田老婦遇襲死、福島狂熊連傷四人

- 遺產想留給誰自己決定!法務部擬刪「兄弟姊妹特留分」 增訂「孝順條款」顧公平

- 零食、水果…信眾買單!律師私吞「貝殼廟」497萬香油錢 判4年半慘遭停職

- 北京加強壓制六四天安門大屠殺紀念 首度禁止家屬到墳前祭奠

- 開庭前套招證人「幫忙圓一下」! 網紅「熊律」簡大為被懲戒停職5月

- 114年度報稅截止!綜所稅申報戶705萬 創新高

- 【中獎清冊一次看】3-4月期統一發票開出20張千萬獎 21元買烏龍奶茶就中大獎

- 聖嬰現象可能持續到11月 未來幾個月持續會有酷熱、暴雨等狀況

- 快訊/百萬國民高息ETF 00919成分股調整出爐!18進18出

- T-34教練機失事!空軍揭關鍵21分鐘 沒彈射椅、無線電未通報

- 三重警被毒駕撞死!被害家屬痛訴他「拒絕出庭談賠償」 求法官重判20年

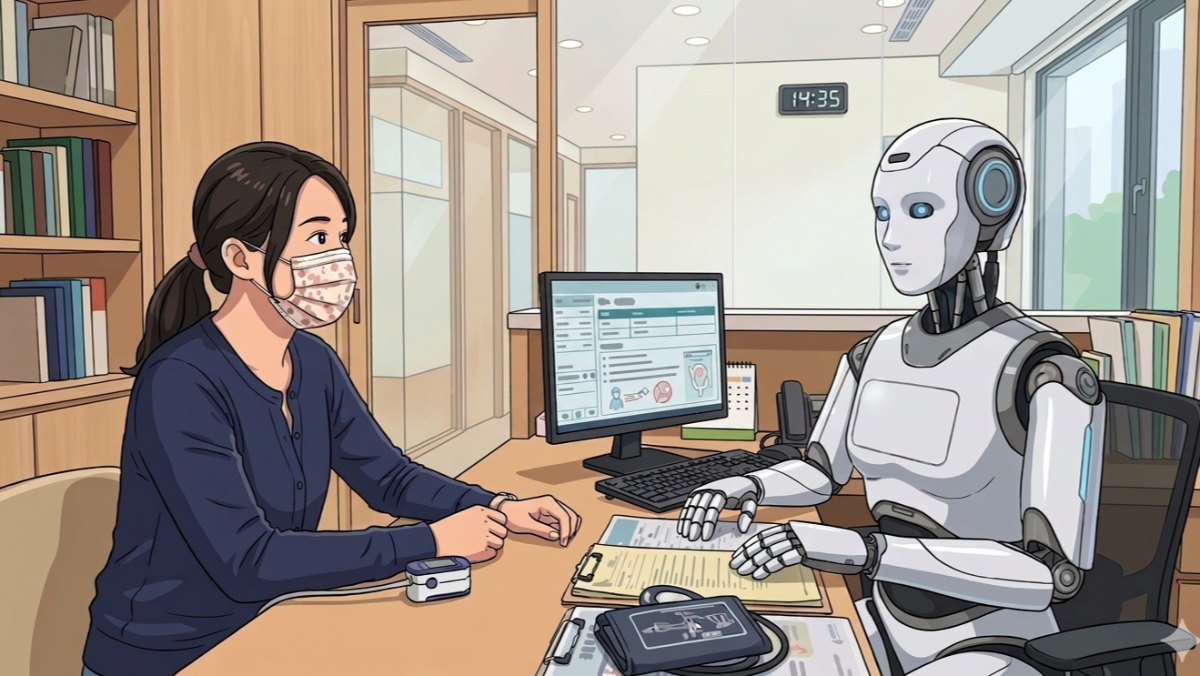

2億人問AI醫療建議!研究打臉:一半答案有問題 最雷的是它

2026-04-16 13:18 / 作者 陳康宜

許多民眾會向AI尋求醫療建議,但它們給的答案真的可靠嗎?研究顯示,高達50%回應不精確。AI生成

「我的皮膚出現紅斑,怎麼辦!」當AI成為醫療諮詢工具,你能判斷答案是正確的嗎?最新研究顯示,AI聊天機器人給出的答案,高達50%是有問題的,其中20%更是錯得離譜。OpenAI數據顯示,每週至少2億人向ChatGPT諮詢健康保健方面的問題。ChatGPT已推出保健工具,Anthropic也準備在Claude推出相關服務。但它們都準備好了嗎?

根據彭博報導,由美國、加拿大和英國組成的研究團隊,針對5大人工智能熱門平台ChatGPT、Gemini、Meta AI、Grok和DeepSeek進行醫療諮詢研究,結果發表在本週的英國跨領域醫學期刊(BMJ Open)。

每個聊天機器人被問的題目,主題涵蓋癌症、疫苗、幹細胞、營養和運動相關等5大類別,類型則分為有明確答案封閉式問題以及開放式問題。

根據報告,重點如下:

1.高達50%的回答「有問題」,其中30%「有些問題」,20%「非常有問題」。

2.封閉式問題回覆較好,開放式問題易出現錯誤資訊。

3.在疫苗和癌症領域表現較好,在幹細胞、運動相關和營養領域表現較差。

4.參考文獻品質較差,平均完整性得分僅40%,意味著它們捏造文章、或產生幻覺。由於聊天機器人依賴數據僅限「開放文章」,使得引用來源不夠廣泛,僅佔目前已發表研究的30%至50%。

5.可讀性評分皆被列為「困難」,用詞艱澀,大學畢業才能理解。

6.所有測試聊天機器人中,Grok出現「有問題」的答案最多,比率高達58%。Gemini出現「有問題」答案的比率最少。

7.聊天機器人回應時,充滿自信與肯定,很少有所保留或免責聲明。在總計250個問題,只有Meta AI曾拒絕回應2個問題,題目與合成代謝類固醇和替代癌症療法有關。

研究人員坦言,他們只測試了5個聊天機器人,且問題經過設計,不見得符合一般情況,但仍顯示聊天機器人有所侷限,它們不會推理或權衡證據,也無法做出道德或基於價值的判斷,「聽起來很權威,卻存在著缺陷」。

研究團隊強調,這些AI平台不具備足以提供醫療建議的許可或授權,也缺乏臨床判斷力,呼籲科技公司應重新審視與評估AI聊天機器人的保健服務,否則可能加劇錯誤訊息的傳播,「生成式AI應該提升公眾健康,而非帶來損害」。

最新more>

- 美伊續交火!IRGC稱飛彈擊中美軍第五艦隊總部 美軍:成功攔截並回擊

- 世足賽》地表最大單一運動盛會!美加墨世界盃48強觀戰懶人包 分組賽程焦點球星全掌握

- 輝達Vera Rubin引爆AI重新訂價! 被動元件複製記憶體超級漲價缺貨潮

- 傳SpaceX將IPO估值定在1.75兆美元 含綠鞋期權

- 英外相訪中會王毅 強調對台政策不變「也不會改變」

- 【水象星座運勢】6/3 巨蟹座觀察篩選對象、天蠍座留意語氣態度、雙魚座檢視標的

- 【火象星座運勢】6/3 牡羊座多加磨合、獅子座振作向前、射手座主動掌握話權

- 【土象星座運勢】6/3 金牛座小額投資、處女座風險過多、魔羯座放下壓力

- 【風象星座運勢】6/3 天秤座獲得喜愛、水瓶座找節流辦法、雙子座增加溝通表達

- 強調美對台政策不變 盧比歐:川普將決定140億對台軍售案

熱門more>

- 抓到「日本AV女優賣淫」畫面曝光 竟是國寶級美少女!極樂價碼驚人

- 「李珠珢小可愛+真理褲」熱舞影片 安全褲整件外露!粉絲心疼:有必要嗎

- 薔薔不忍了!胞妹被妻爆料「家暴、騙孕、偷吃」 氣炸切割:不會幫她善後

- 轎車男放開雙手「全靠輔助駕駛」 40秒後撞聯結車!車上3人慘死

- 大立光林恩平7天拍板CPO參展COMPUTEX! 自開模具8個月CPO方案曝光

- 重大突破!「抗癌標靶新藥」結果報喜 癌末近半數「好轉」15人腫瘤消失了

- 佳世達COMPUTEX大秀AI基建 陳其宏:佳世達AI技術全到位 股價將起飛

- 週刊爆馬辦查帳最新進度!稱台商捐款攏是假 王光慈提領馬帳戶款項待查

- 日本女優做S遭逮哭了 「明碼標價」肉食撲台內幕曝!AV達人26字勸世

- 不滿內政部要求分攤租屋補助 蔣萬安轟「中央請客地方買單」