快訊

- 台股崩盤說再起 謝金河:震盪向上不崩盤、健策腰斬是這原因

- 西班牙5月101人因高溫死亡 創11年來新高

- 納坦雅胡:是否恢復對伊朗全面戰爭由川普決定 荷姆茲海峽可以強行打開

- 【有片】薔蜜襲日降雨量破6月紀錄 多地淹水居民驚「早上醒來變了樣」

- 行政院周四擬拍板提高毒駕刑責與罰鍰 涉案車輛研擬沒收機制

- 台中女童遭虐死!2度報警仍沒救下「挨轟冷血」 社會局、警察說法一次看

- 【更新】太子集團OJBK錢包合作水房找到了 鳳玖負責人夫婦400萬交保、律師張秉鈞100萬交保

- 美國5月服務業景氣回升優於預期 企業預期缺料漲價提前下單

- 涉詐補助、侵吞公益金還收賄 前綠營議員黃俊哲「一魚三吃」遭羈押禁見

- 100%命中! 陸軍Altius-600M無人機首度射擊海上目標 破解不利傳聞

- 【有片】讓普丁難看!「俄版達沃斯」經濟論壇前夕 烏克蘭無人機猛轟聖彼得堡

- 彭博:歐盟已形成共識 無法避免與中國的貿易戰

- AI造成的「晶片通膨」 可能危及電腦、手機等消費端市場

- 因伊朗戰爭壓力 歐盟今年可能新增100萬人失業

- 《美女與野獸》《阿拉丁》美聲 歌手比柏布萊森病逝、享壽75歲

- AI教父黃仁勳離台前犒賞輝達員工 北流辦桌飄台味

- 美擬引301條款就「強迫勞動」對台課10%關稅 經濟部:應是銜接122條款 不致有關稅疊加

- 伊朗攻擊科威特機場 航廈被毀至少1死63人傷

- 王定宇外遇醫師娘訊息造假?葛斯齊轟「胡扯」不忍了 加碼再告他2罪

- C、D槽很滿!婦產科色醫加入「蘿莉群」 竟收藏性侵被害人驗傷照 一審判決曝

【AI感受調查6-1】期待又怕隱私外洩!女比男越怕AI使壞越願意學

2025-05-26 08:00 / 作者 洪敏隆

AI帶來生活便利,但也衍生隱私等風險問題。本報繪製

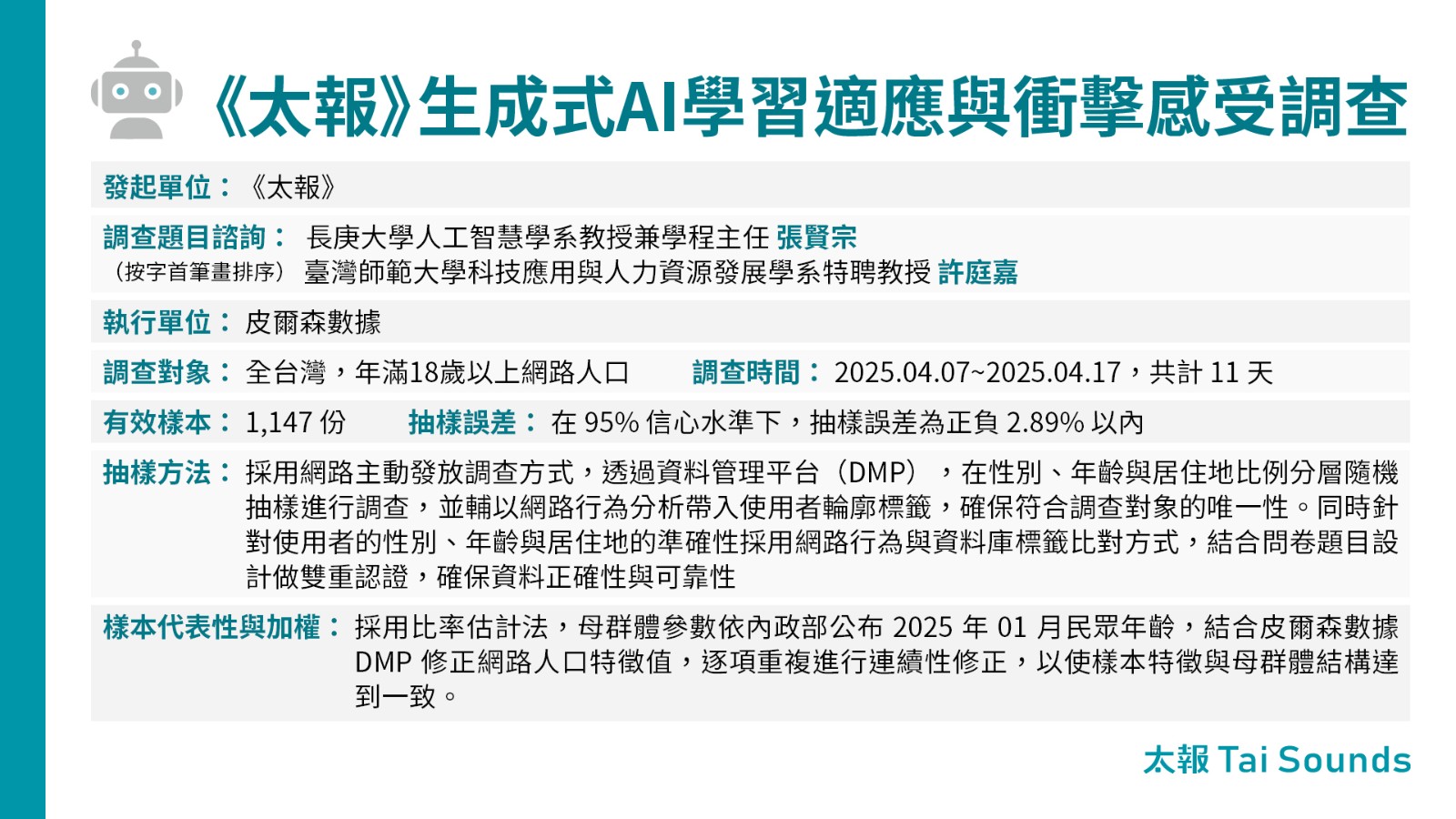

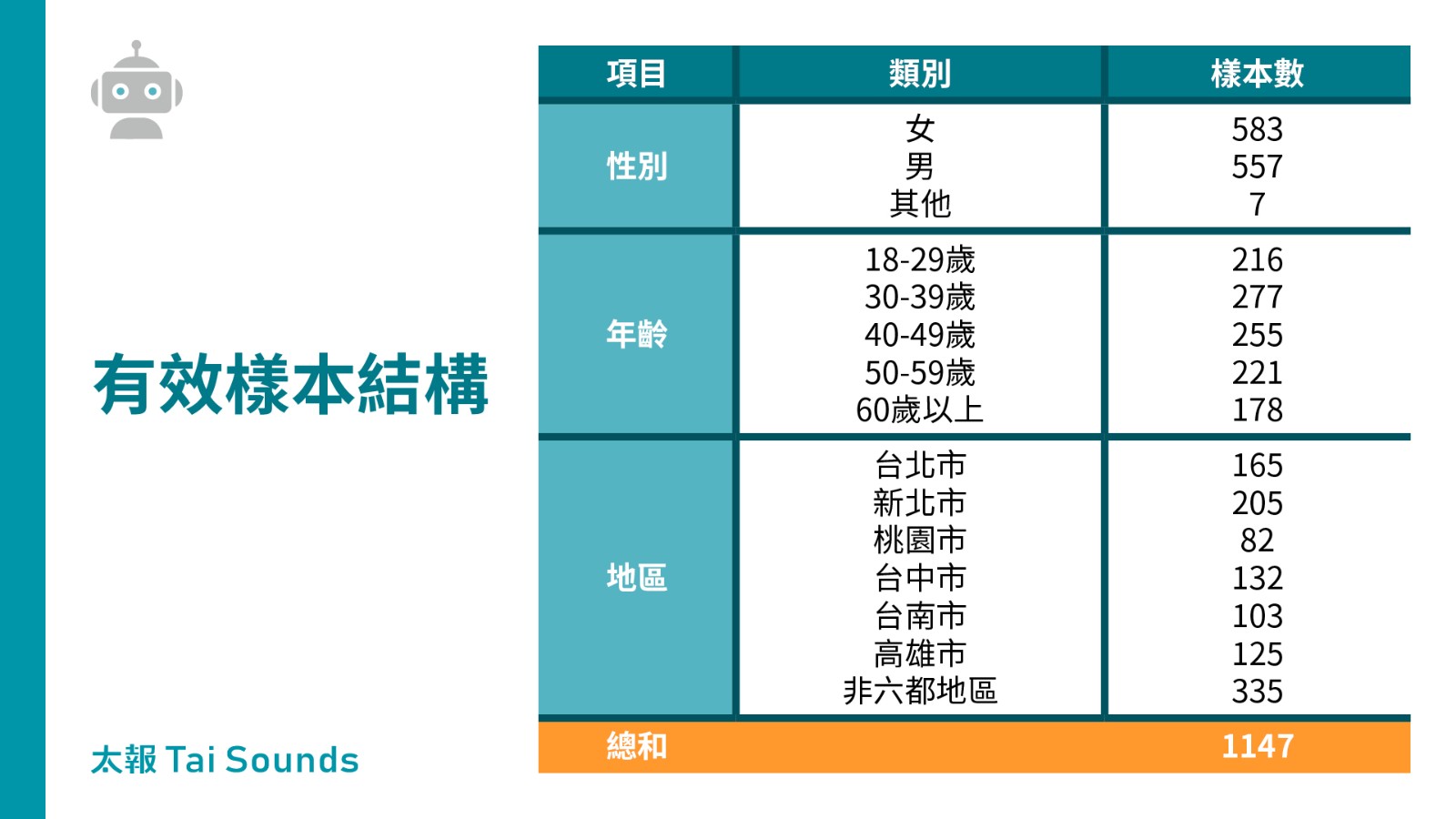

生成式AI為工作和生活帶來巨大的效率及助益,同時也可能對個人或社會帶來新的風險和影響。根據《太報》委託皮爾森數據公司進行的「生成式AI學習適應與衝擊感受調查」顯示,民眾對生成式AI的公共服務領域應用有多元期待,卻也有隱私等顧慮,值得關注的是女性族群風險感知越高,反而更願意主動學習與接觸這項技術。

生成式人工智慧(AI)技術的快速發展,影響人們的生活與行為,相關的道德、法規與社會考驗隨之而來,因此行政院研擬我國AI發展政策的上位規範「人工智慧基本法」草案,重點除了促進我國創新的AI發展環境,另一個重點在於「AI治理」,強化資料治理與風險管理。

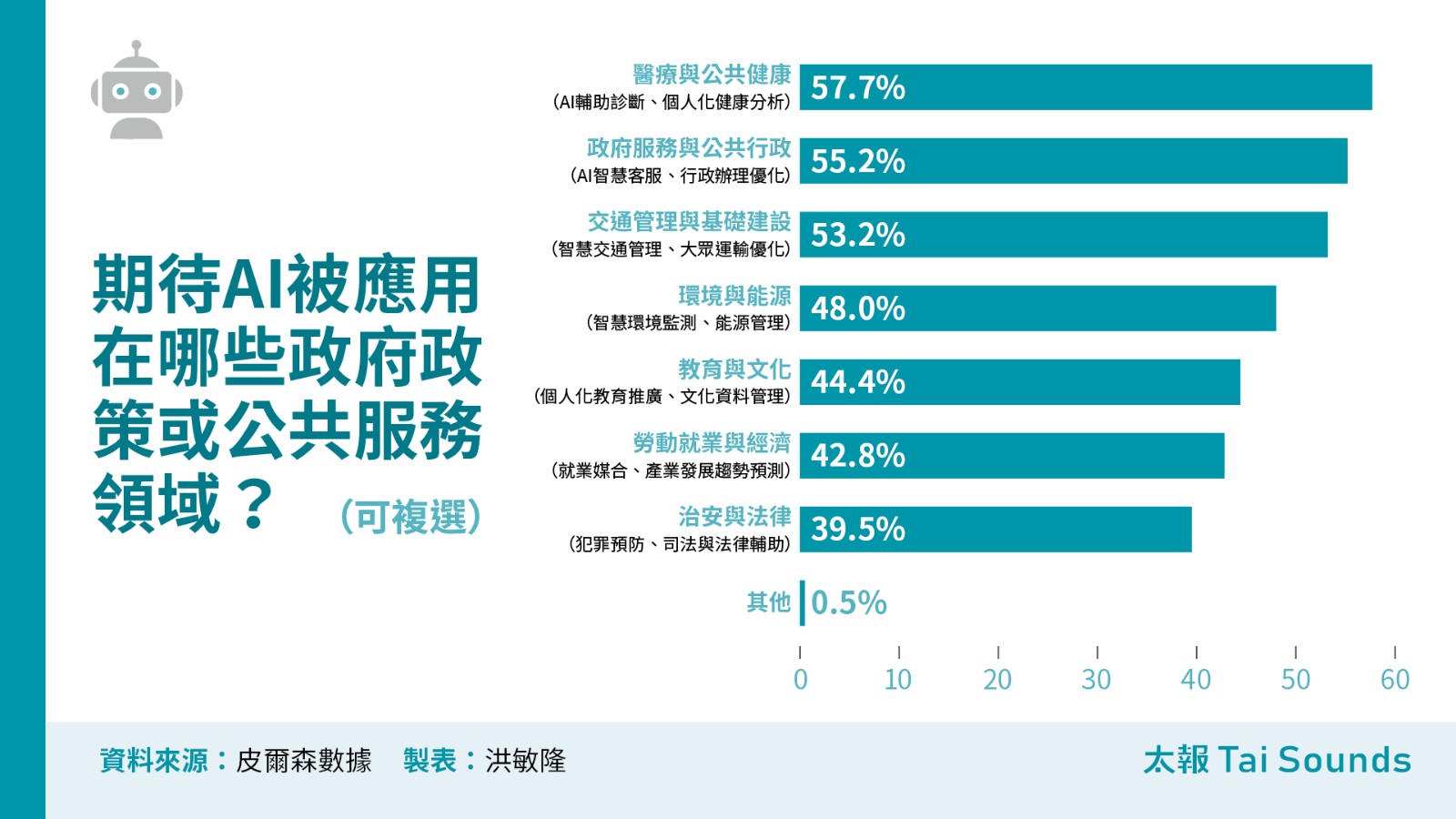

本次調查顯示,民眾對生成式AI在政府政策與公共服務領域的應用有廣泛且多元的期待,其中以 「醫療與公共健康」(57.7%)、「政府服務與公共行政」(55.2%)及「交通管理與基礎建設」(53.2%)為前3名的領域,選擇比例皆超過5成,顯示民眾更期待生成式AI被應用於提升日常生活便利性、健康保障與基礎設施效率方面的潛力。

據了解,政府相關部會都在推動AI,交通部著重在落實人本交通,例如透過AI辨識人流車流,進行警示或調節號誌,確保弱勢用路人的用路安全;衛福部則是在台灣5家醫學中心創設「AI影響性評估中心」,證AI的臨床效益,例如三軍總醫院利用AI判讀心電圖,提早診斷心肌梗塞,並透過救護車即時傳輸資訊至接收醫院,加速病患從診斷到接受導管治療的時間。

生成式AI隨著技術發展和使用越來越廣泛,AI的倫理問題也變成全球關注的焦點,隱私、安全、侵犯著作權及認知偏差等都是AI倫理面臨的挑戰,此次調查因此想藉由這幾個問題的看法,了解民眾的風險認知程度。

社群媒體曾瘋玩生成式AI的吉卜力圖像,引發著作權爭議。照片取自吉卜力工作室網站

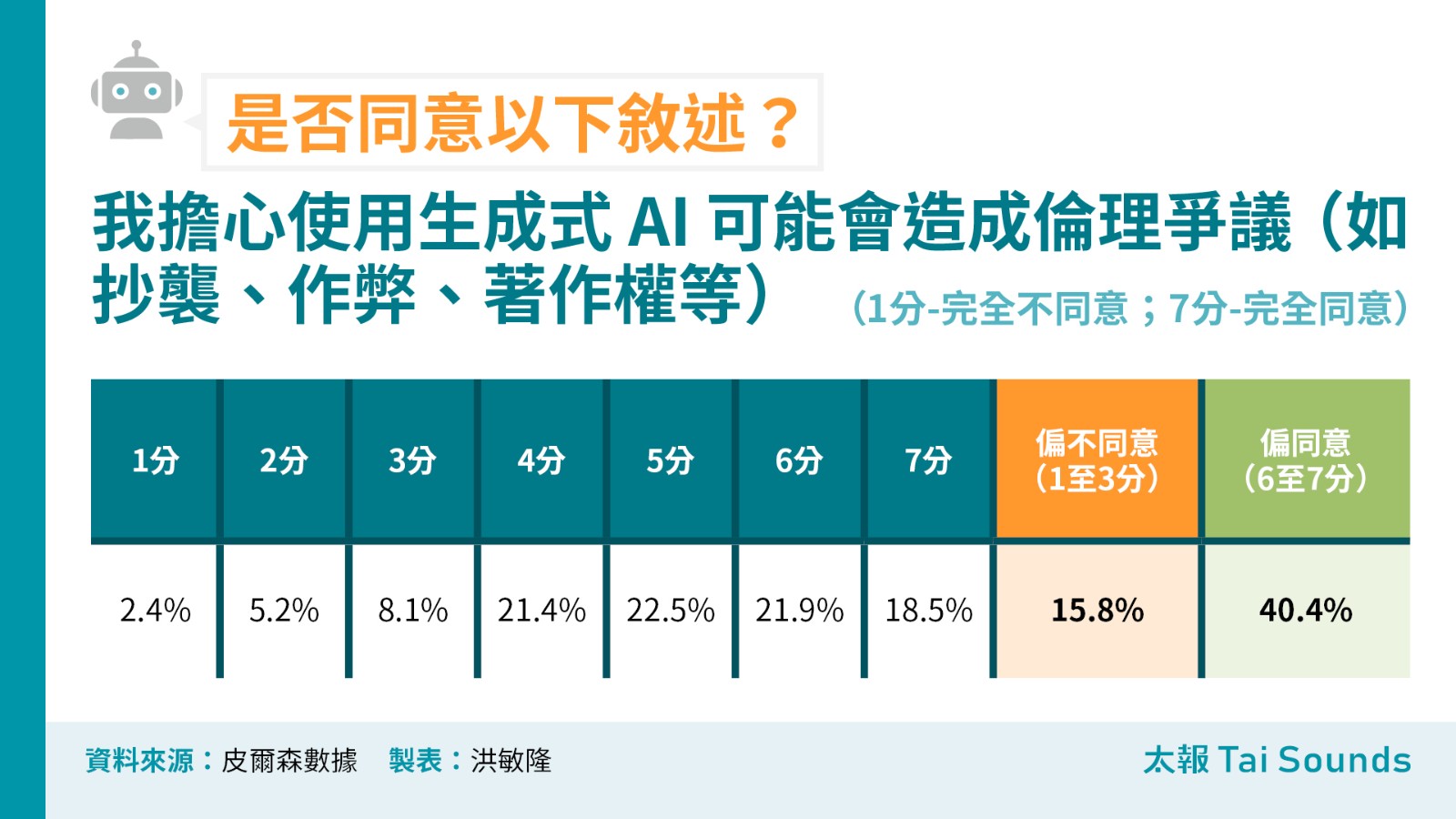

前陣子社群上瘋玩ChatGPT「吉卜力風格」,上傳照片可快速生成吉卜力風格照片,此次調查發現,超過6成民眾(5分以上為62.9%)對「使用生成式AI可能會造成抄襲、作弊及著作權等」表達一定程度認同,高度認同者(6至7分)更高達40.4%,低度認同的比例只有15.8%。

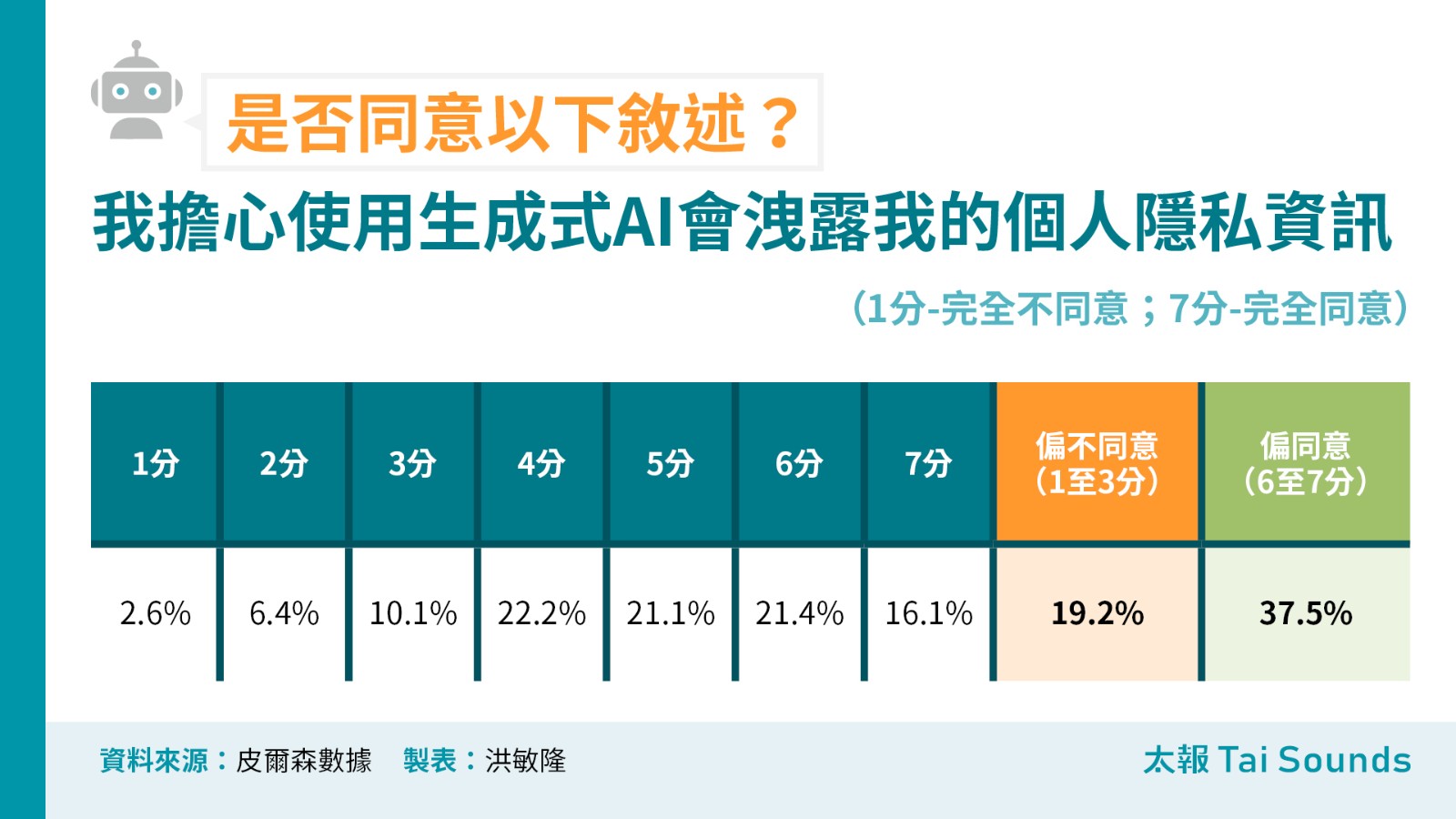

調查發現,另一個台灣民眾較認同的影響是隱私問題,有58.6%受訪者對「使用生成式AI會洩露個人隱私資訊」有一定程度認同,有將近4成(37.5%)是高度認同。

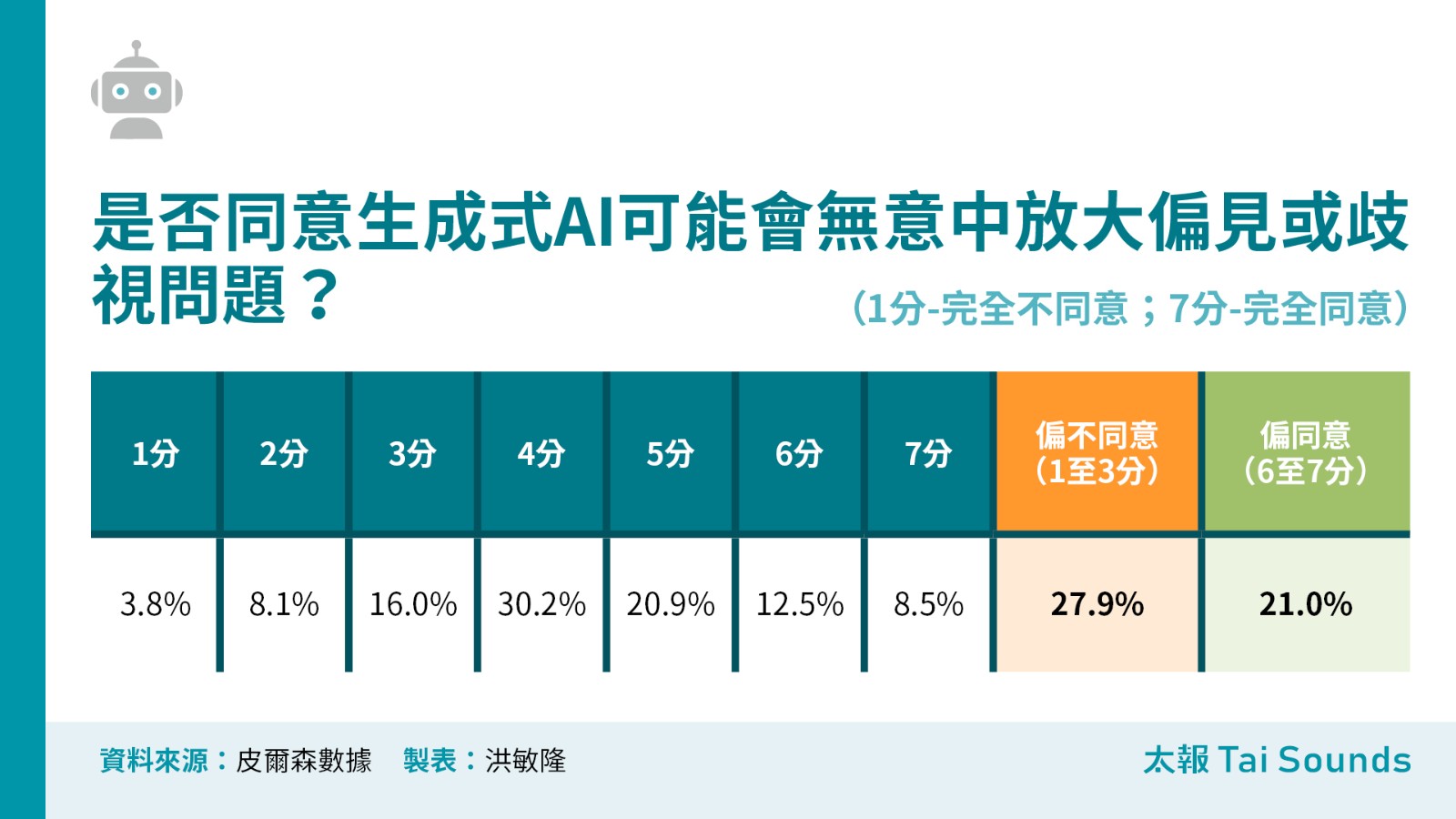

此外,對於「生成式AI可能會無意中放大偏見或歧視問題」有一定程度的認同是41.9%,高度認同比例是21%。其中,50歲以上男性的認同程度相對較高,50至59歲有一定程度認同的比例是52.9%,60歲以上也有50.5%。

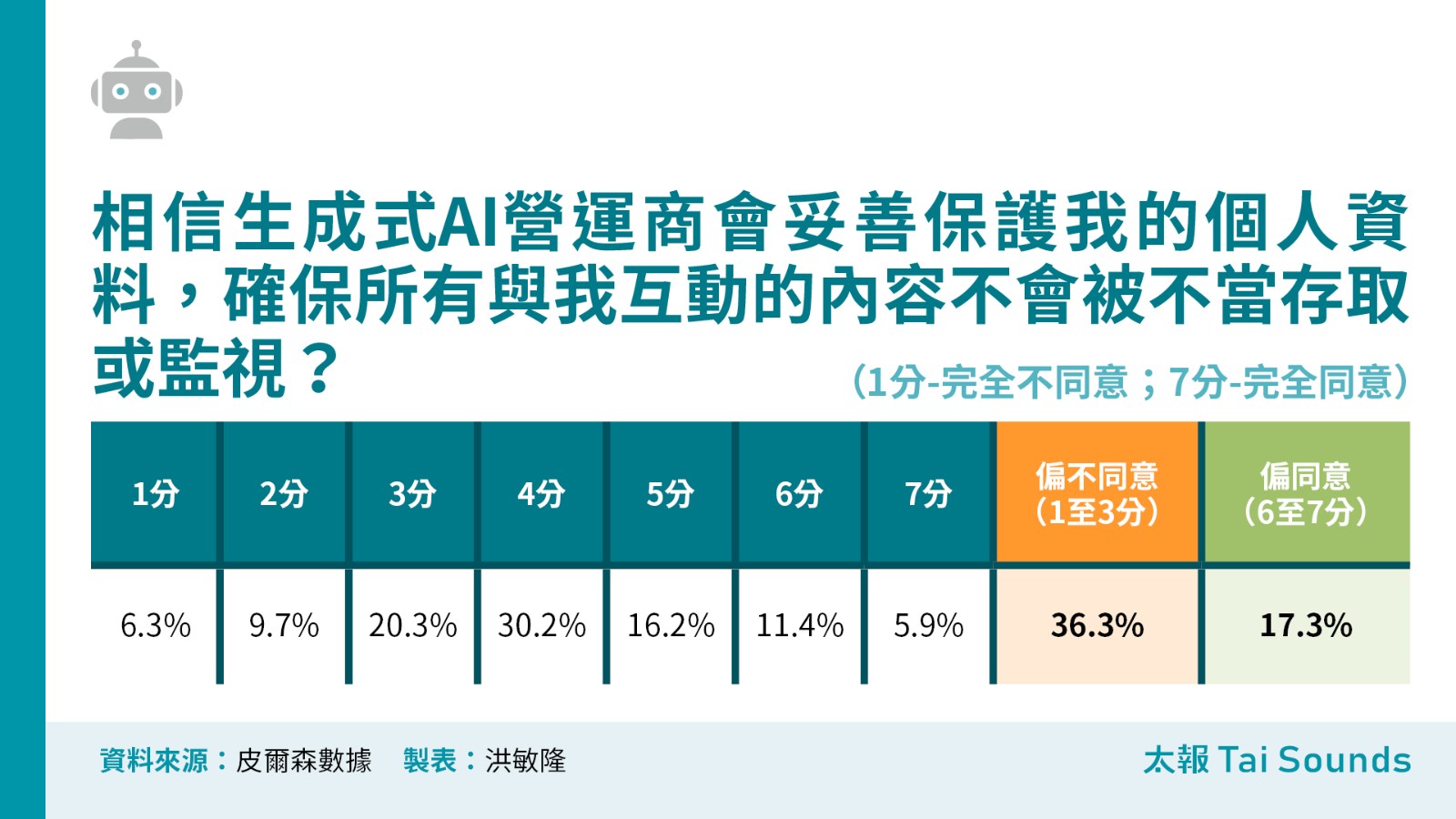

對於AI營運商的治理是否具有信心,有36.5%是非常不認同其會妥善保護其個人資料,確保所有與受訪者互動的內容不會被不當存取或監視,其中以30至39歲的女性的不認同比例最高(43.4%)。

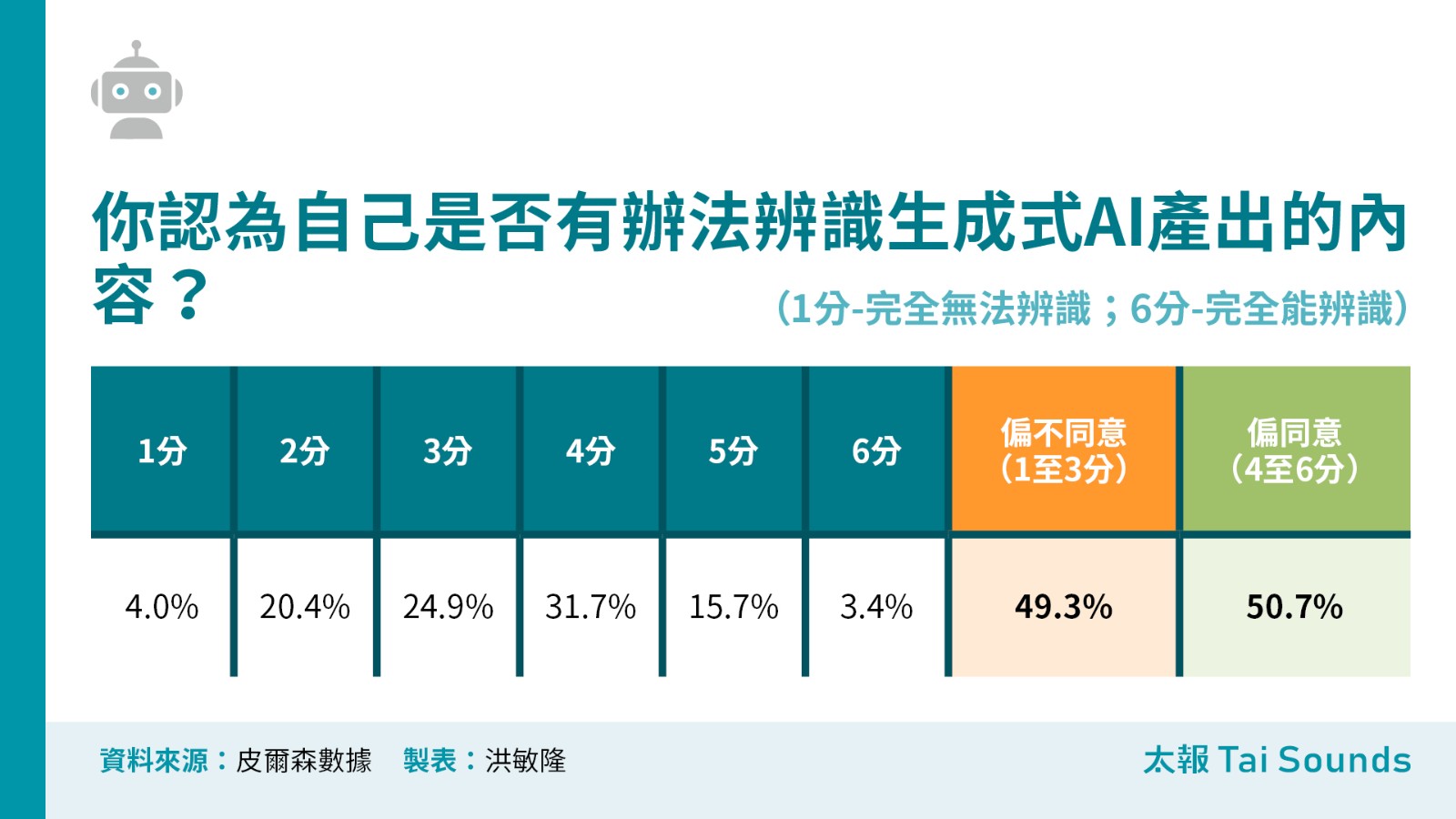

在擔憂層面上,本次調查結果顯示,整體民眾對於生成式AI內容的辨識信心認為「可能可以辨識」,而非明確自信。值得注意的是,也有24.4%的民眾選擇2分以下,接近四分之一,顯示仍有相當比例對於辨識生成式AI內容抱持較低信心。且隨著年齡增加,信心是逐步遞減。

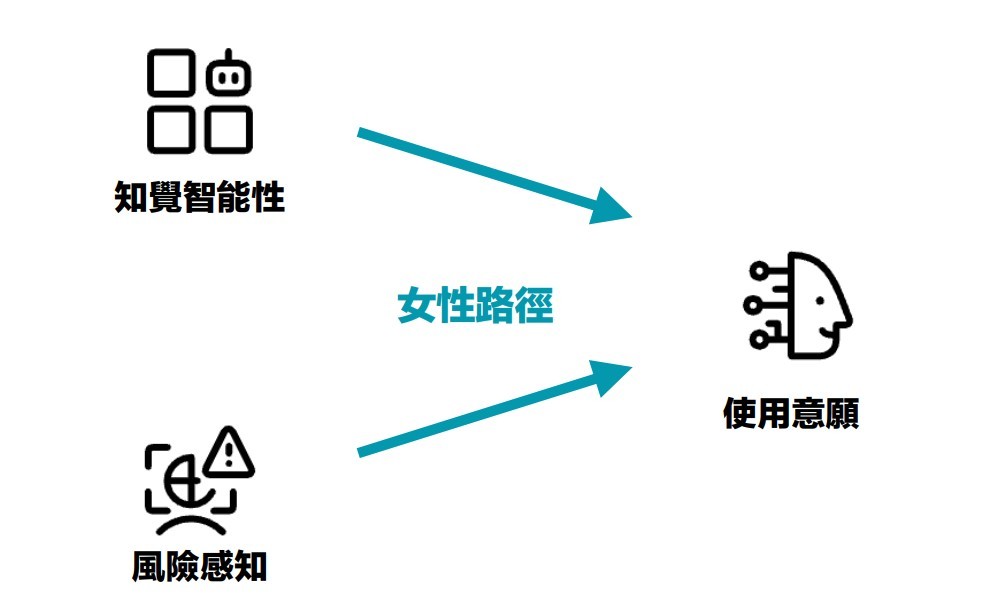

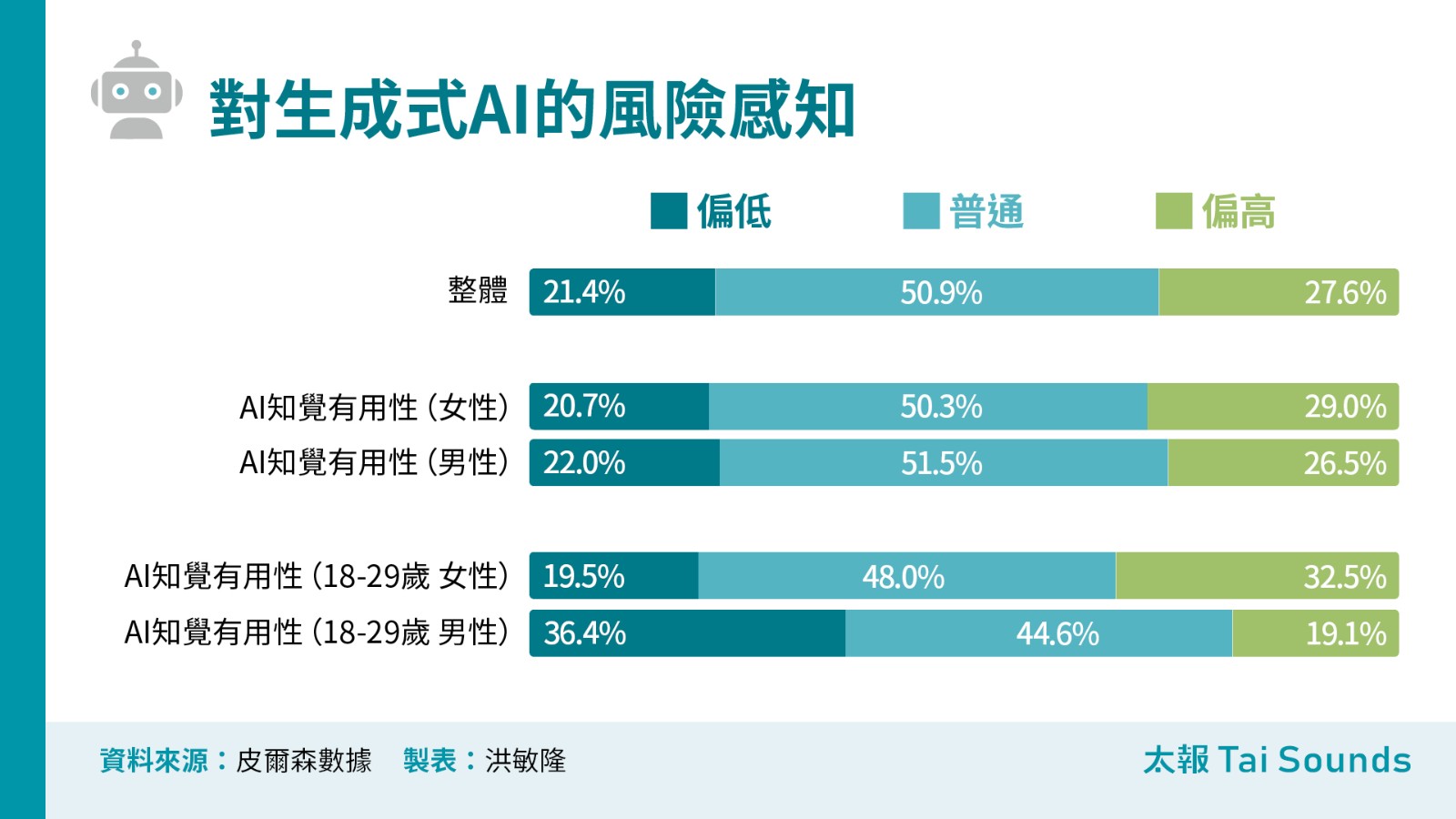

不過,值得關注的是,風險感知的提升,並不必然導致排斥使用生成式AI,從「AI素養驅動」的角度來看,風險感知不僅代表憂慮,也可能代表使用者對相關技術有更深入的理解與關注。此次調查可以發現,女性族群若對生成式AI可能引發的風險擔憂有高度警覺,反而更可能主動學習與接觸這項技術。

以18-29歲為例,認為AI是有用的女性受訪者中,有32.5%的風險感知是偏高,反觀男性只有19.1%,這顯示對於女性來說,風險感知的提升,並不必然導致排斥使用生成式AI,反而可能在理解風險的過程中,促進對技術價值的認同與接受。因此,讓大眾能夠清楚掌握生成式AI所涉及的潛在風險,應被視為推廣科技使用的重要一環,而非阻礙。

然而,相較之下,男性在面對生成式AI時,風險感知並不顯著影響其實際的使用意願,即便意識到AI可能存在資料安全、倫理爭議等風險,這些擔憂並不會明顯左右他們是否選擇使用。值得注意的是,男性在面對新科技時,對風險的判斷一部分建立在「科技本身是否夠聰明、好用」的主觀印象上。只要AI在互動過程中表現出足夠智能,他們便傾向相信風險可控、不易發生。

台灣人工智慧學校秘書長侯宜秀形容「人工智慧就像一把刀」,它會帶來好處也會帶來壞處,端看使用者怎麼用。所以對於人才的培育,培養使用者怎麼正確的去使用這把刀,是重中之重。她認為AI素養應該是未來每一個人從小老都應該具備,AI素養包括了理解技術邏輯、運用技術工具、評估、反思AI的能力。特別是反思和評估,這是目前比較少重視到的,但卻是如何讓我們不受AI傷害非常重要的一環。

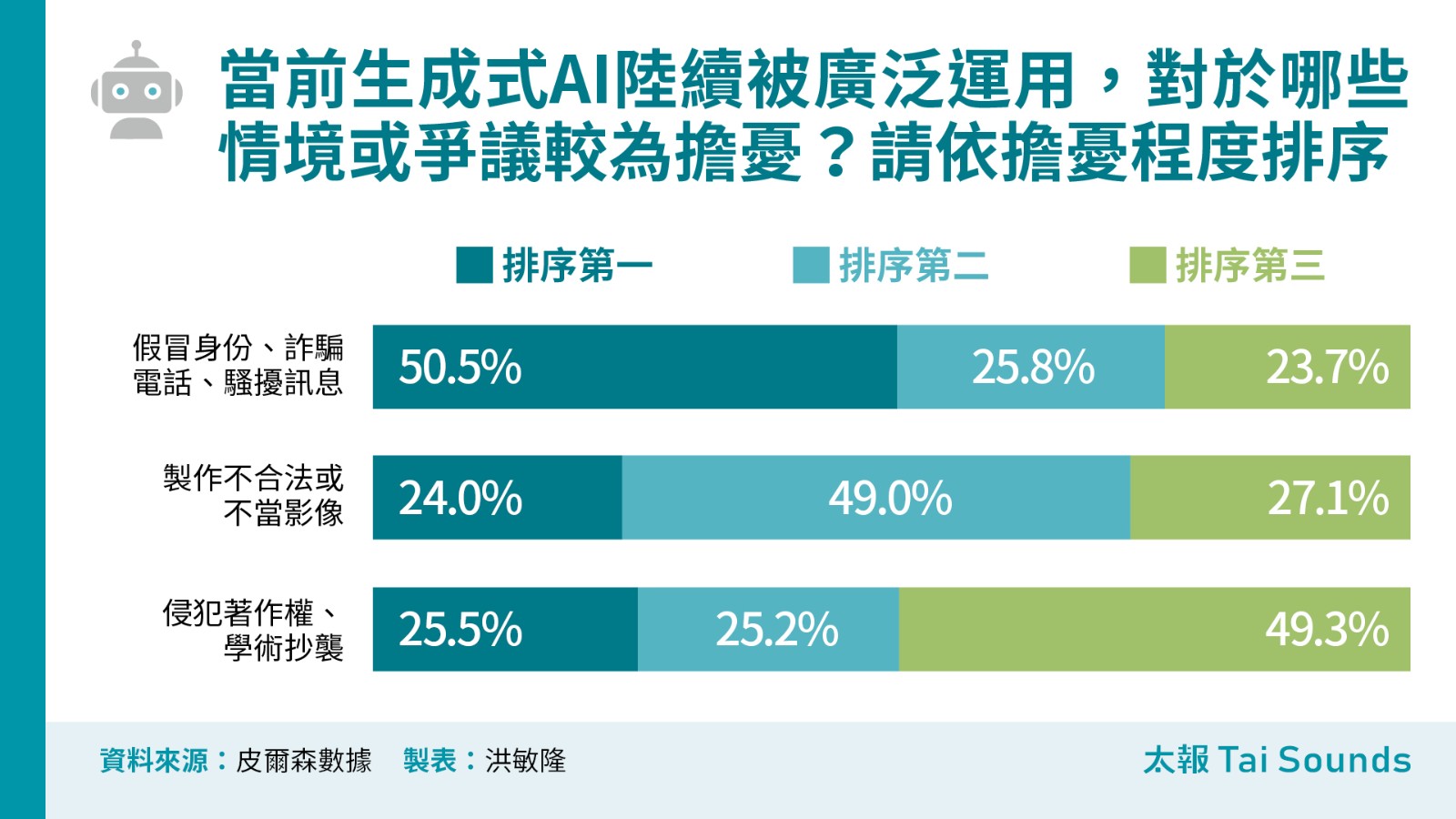

雖然受訪民眾認同生成式AI可能涉及抄襲、違反著作權的比例超過6成,但當問到民眾面對生成式AI帶來的潛在爭議,整體擔憂「侵犯著作權、學術抄襲」只是排在第三順位,「假冒身份、詐騙電話、騷擾訊息」列為最主要的第一順位擔憂,其次為「製作不合法或不當影像」(49.0%,第二順位)。

在性別差異上,女性相較男性更傾向將「假冒身份、詐騙電話、騷擾訊息」視為首要風險(53.4%); 而男性最擔憂「製作不合法或不當影像」風險比例相對較高(27.1% vs. 女性21.1%)。

年齡層部分,年輕族群(30歲以下)對這3種情境的擔憂排序相對平均,但隨著年齡上升,民眾的擔憂趨於集中在「假冒身份、詐騙電話、騷擾訊息」視為最嚴重的威脅,且比例遠高於其他選項,反映出高齡族群對生成式AI被用於詐騙行為的高度警覺與不安感。

在立法院「人工智慧基本法」草案公聽會,Gogolook政府關係暨公共策略經理林意蓉指出,當前的詐騙集團,有非常精細的產業分工,AI運用速度也超乎大家想像,如果要做好AI防詐,前期的偵測是關鍵點,不再只是被動觀測,須提前知道哪些是未來詐騙出現的場景,或是將來詐騙是以什麼形式在市面上流通。

生成式AI帶來方便,但也出現很多假資訊。照片取自財團法人人工智慧科技基金會官網

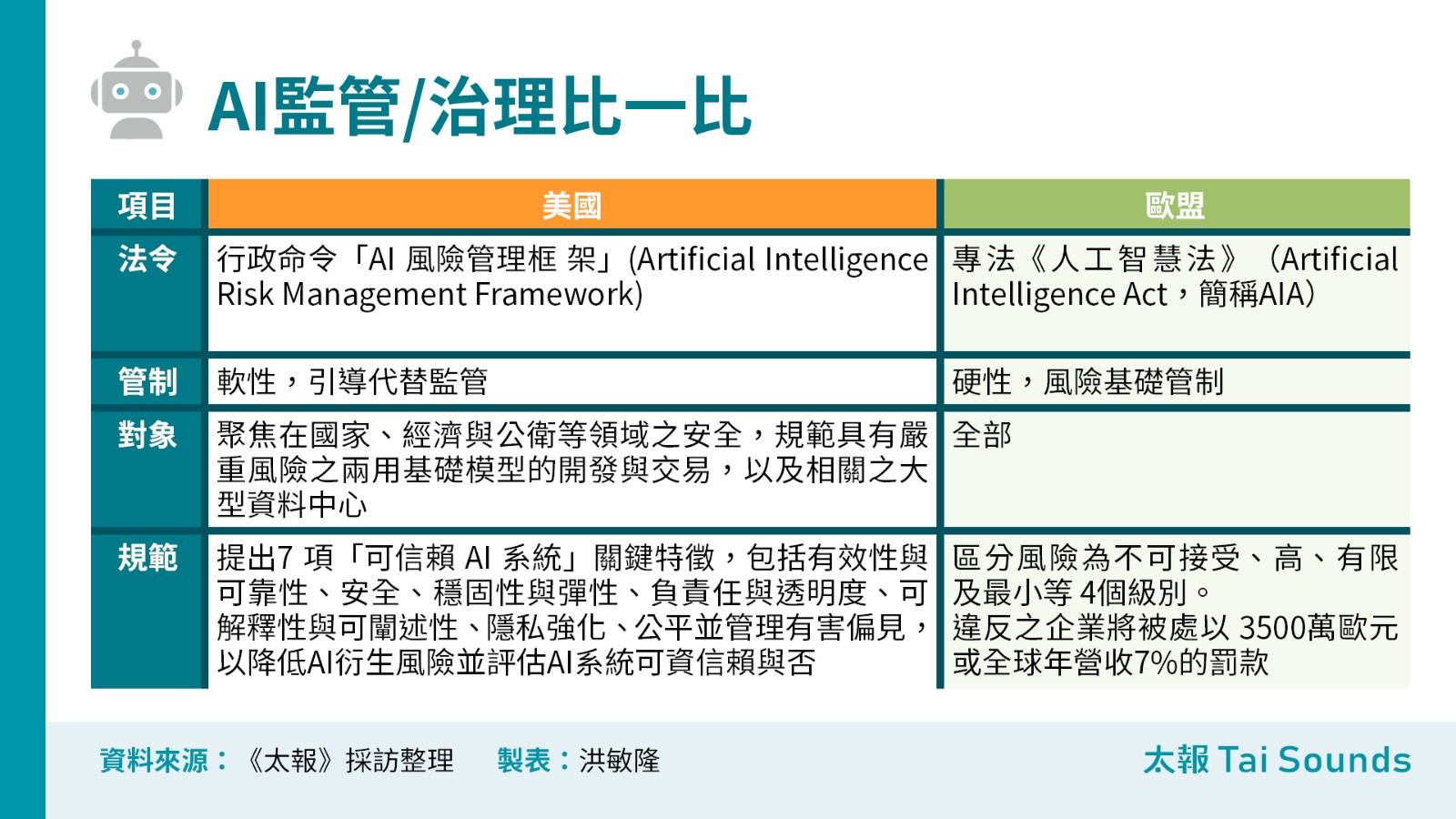

資料治理與風險管理都是AI治理的關鍵,台灣需要建立什麼樣的人工智慧治理模式,是未來制定基本法必須審慎考量的重點。

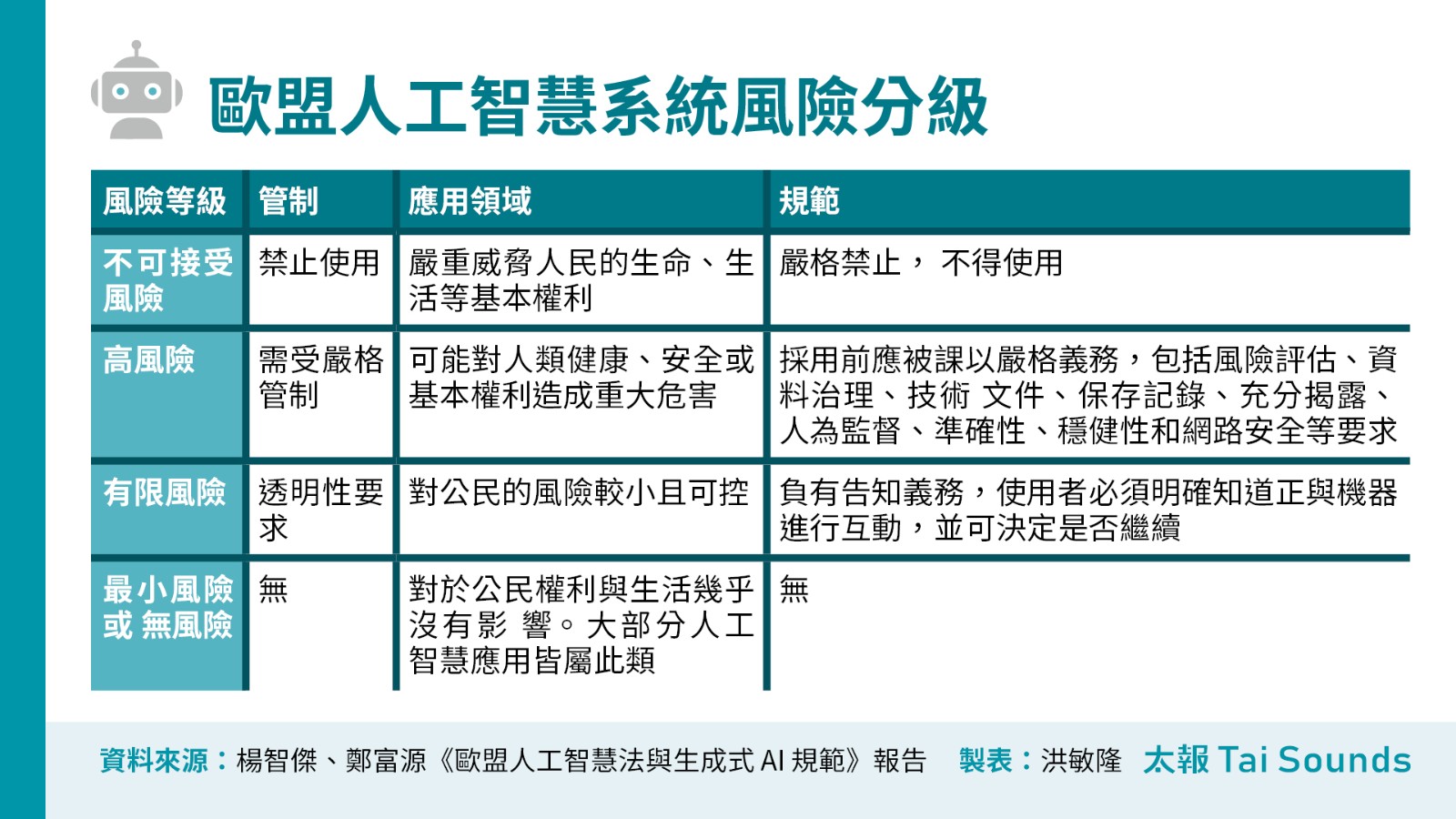

目前國際間主要有兩種模式;歐盟模式強調「風險為本」的監理理念,建立全面的風險分級管理體系,對高風險應用訂定嚴格規範與審查機制,保障基本人權與社會安全;美國模式認為過多規範不利於創新研發與AI發展,鼓勵企業與公部門落實自律與負責任的AI開發導入。

中央研究院法律學研究所特聘研究員李建良指出,兩種模式差別在於規範對象差異,美國模式規範政府部門,歐盟模式規範人民和業者。要制定風險分級,應討論風險分級的機制和實施問題,需明確由誰來判斷風險等級,因此主管機關不只是協調角色,還應有決策和執行能力。

MeetAndy AI共同創辦人薛良斌建議,立法應參考歐盟法令的4級風險架構,加入台灣產業特色,並由行政院指定或設立專責機關,負責相關風險評估。

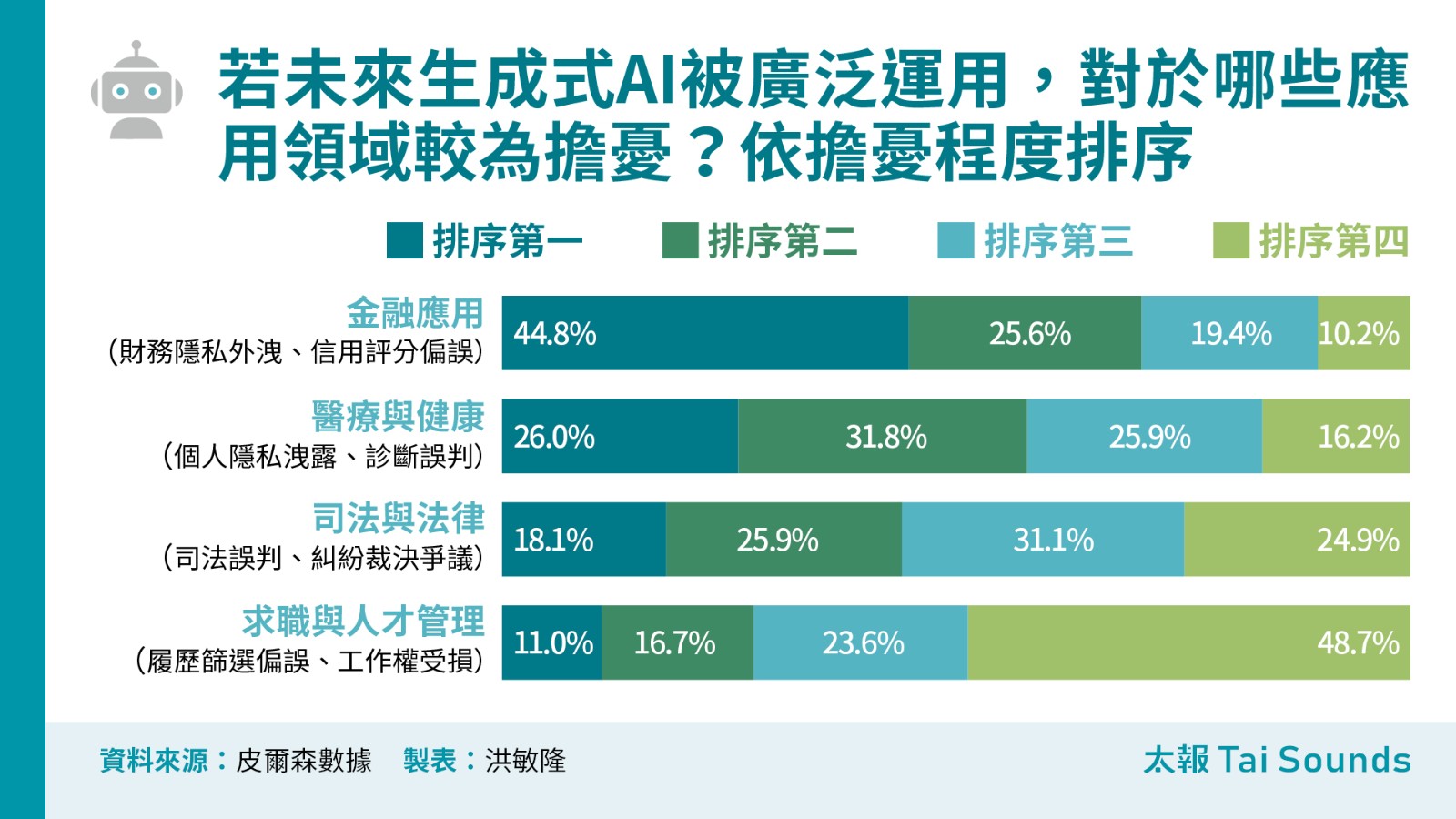

民眾對於未來政策的AI應用,雖然有多元期待,但對於潛在風險,最擔憂的還是隱私外洩。最擔憂(排序第一)比例第一名是「金融應用」(44.8%),如財務隱私外洩、信用評分偏誤,為民眾最主要的擔憂來源。也有26%選擇「醫療與健康」(個人隱私洩露、診斷誤判)是第一名。

深入分析,60歲以上族群中,有54.1%將金融應用列為首要擔憂,是各年齡層最高。18-29歲年輕族群中,女性相對更在意醫療與健康(43.0%),推測與年輕女性對個人隱私資料安全的重視有關。

司法與法律(司法誤判、糾紛裁決爭議)及求職與人才管理(履歷篩選偏誤、工作權受損),雖然擔憂程度相較前兩項,擔憂排序較低,但是男性在這兩項選為排序第一的比例分別有28.9%及18.3%,相對女性較高。

司法改革基金會認為,未來在基本法中的「權利保障條款」尤為重要。例如,應透過立法肯認人民的「隱私權」(包含資訊自決權、保密權、匿名權等)、自主權(包含退出權、要求最小資料化、獲得具有實質意義替代方案等權利)等。

最新more>

熱門more>

- 抓到「日本AV女優賣淫」畫面曝光 竟是國寶級美少女!極樂價碼驚人

- 薔薔不忍了!胞妹被妻爆料「家暴、騙孕、偷吃」 氣炸切割:不會幫她善後

- 轎車男放開雙手「全靠輔助駕駛」 40秒後撞聯結車!車上3人慘死

- 大立光林恩平7天拍板CPO參展COMPUTEX! 自開模具8個月CPO方案曝光

- 「李珠珢小可愛+真理褲」熱舞影片 安全褲整件外露!粉絲心疼:有必要嗎

- 日本女優做S遭逮哭了 「明碼標價」肉食撲台內幕曝!AV達人26字勸世

- 文組也能進輝達!黃仁勳「開649萬年薪」 還能遠距離工作

- 驗屍瞬間鼻酸!台中2歲女童遭丟洗衣機虐死 地獄生活曝光…媽媽1個妥協斷送她活路

- 佳世達COMPUTEX大秀AI基建 陳其宏:佳世達AI技術全到位 股價將起飛

- 出手了!民進黨大老吳乃仁欠台糖1.7億 北院派人住處拘提撲空